音声認識技術や音声合成技術の進化により、AI音声処理の活用が急速に広がっています。

日常的に使用するスマートフォンやスマートスピーカーから、カスタマーサポートや自動翻訳に至るまで、さまざまな分野でAI音声処理技術が利用され、私たちの生活に革命をもたらしています。

本記事では、AI音声処理の基本的な仕組みから、実際にどのような場面で活用されているのか、また未来の可能性についても詳しく解説します。

AI音声処理技術がどのように働き、どのように私たちの生活を豊かにしているのかを知ることで、今後の進化にも注目していきましょう。

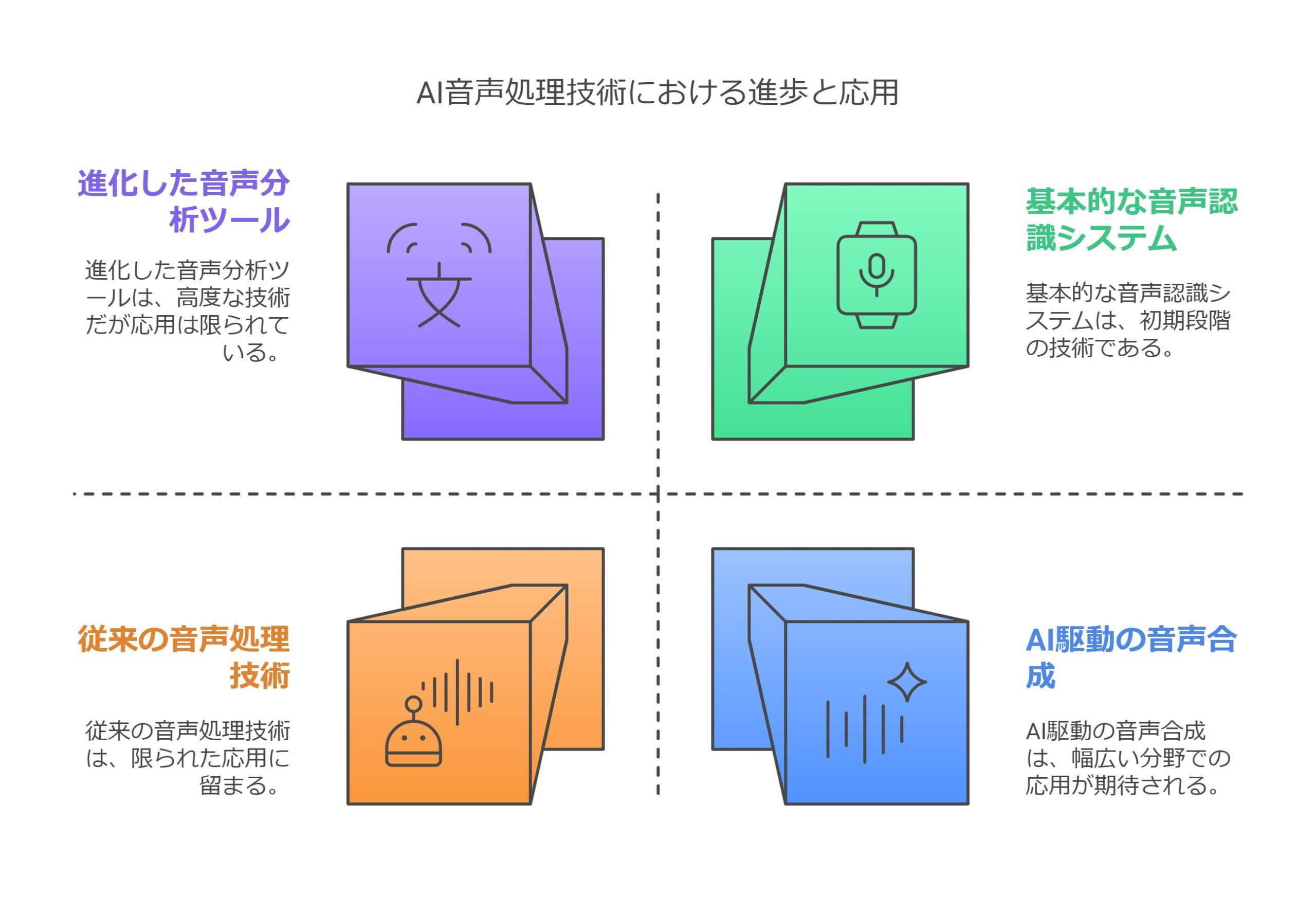

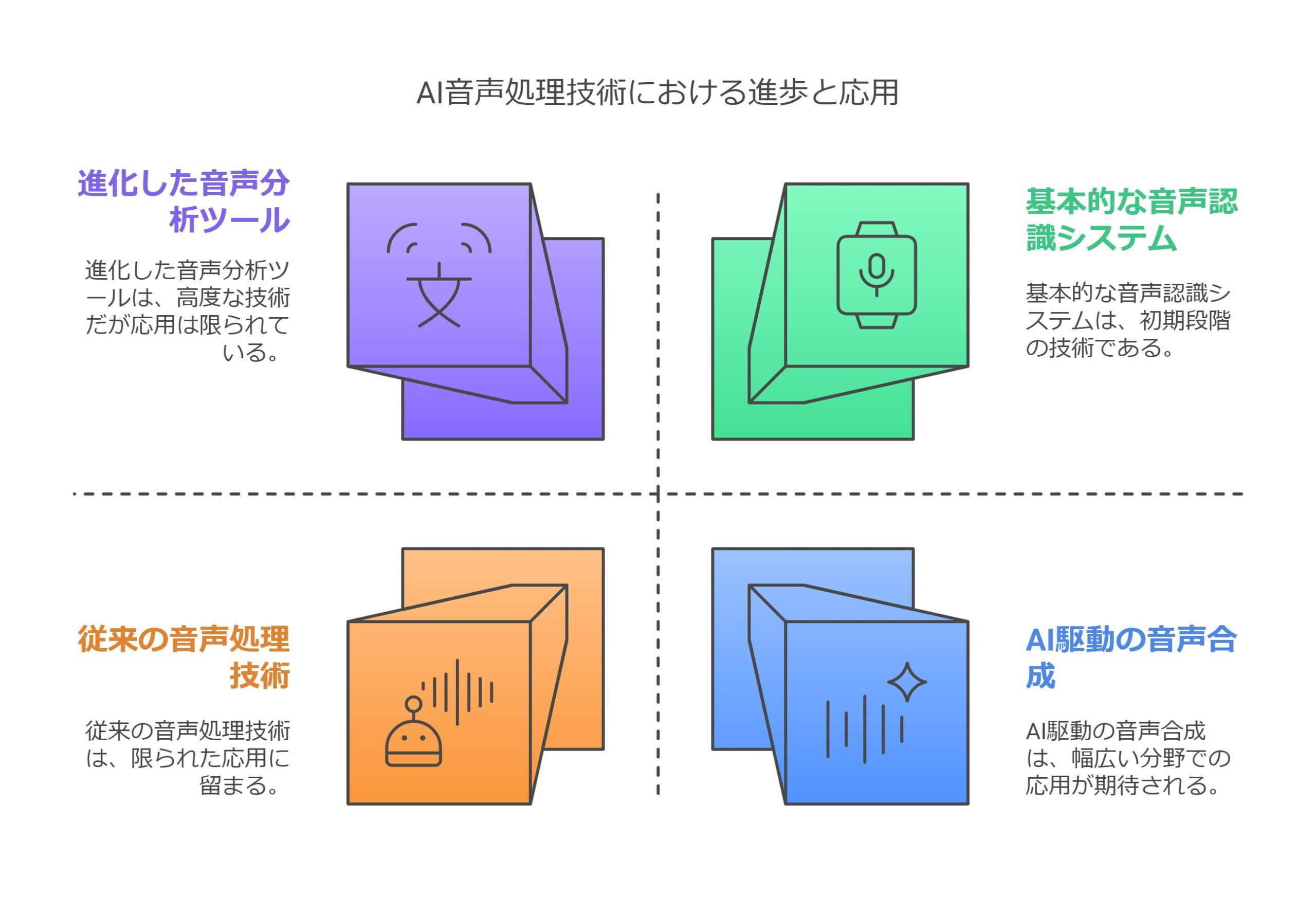

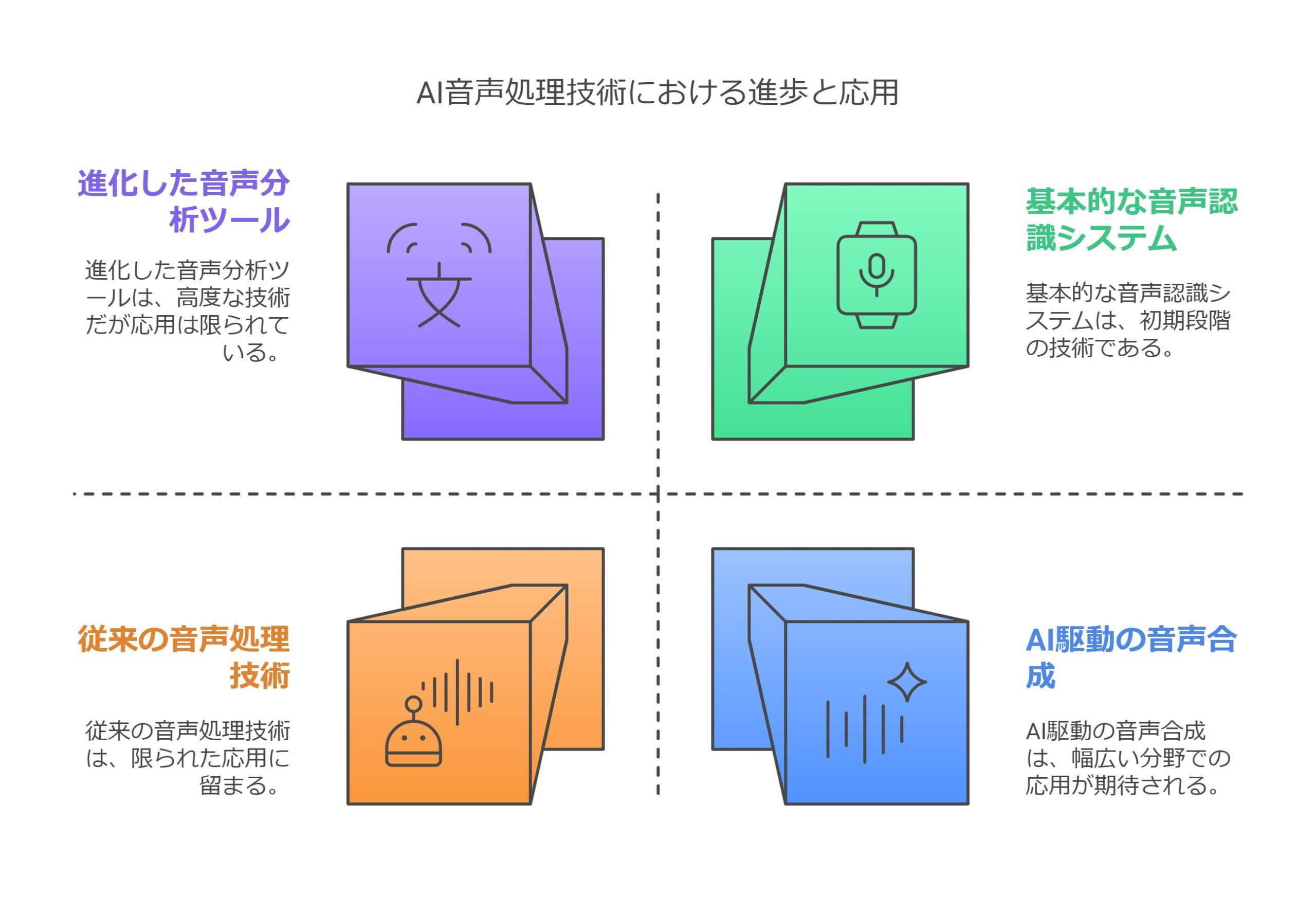

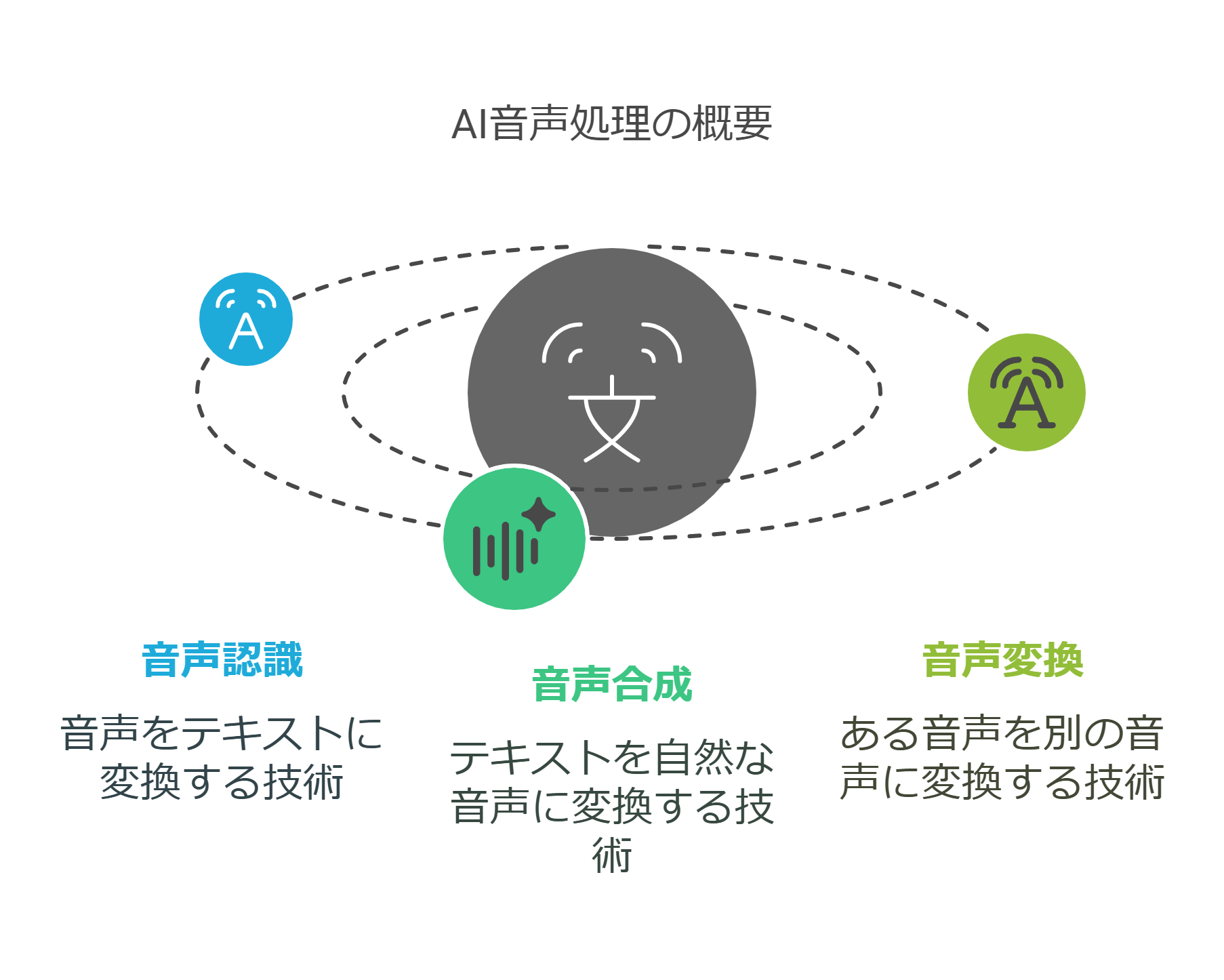

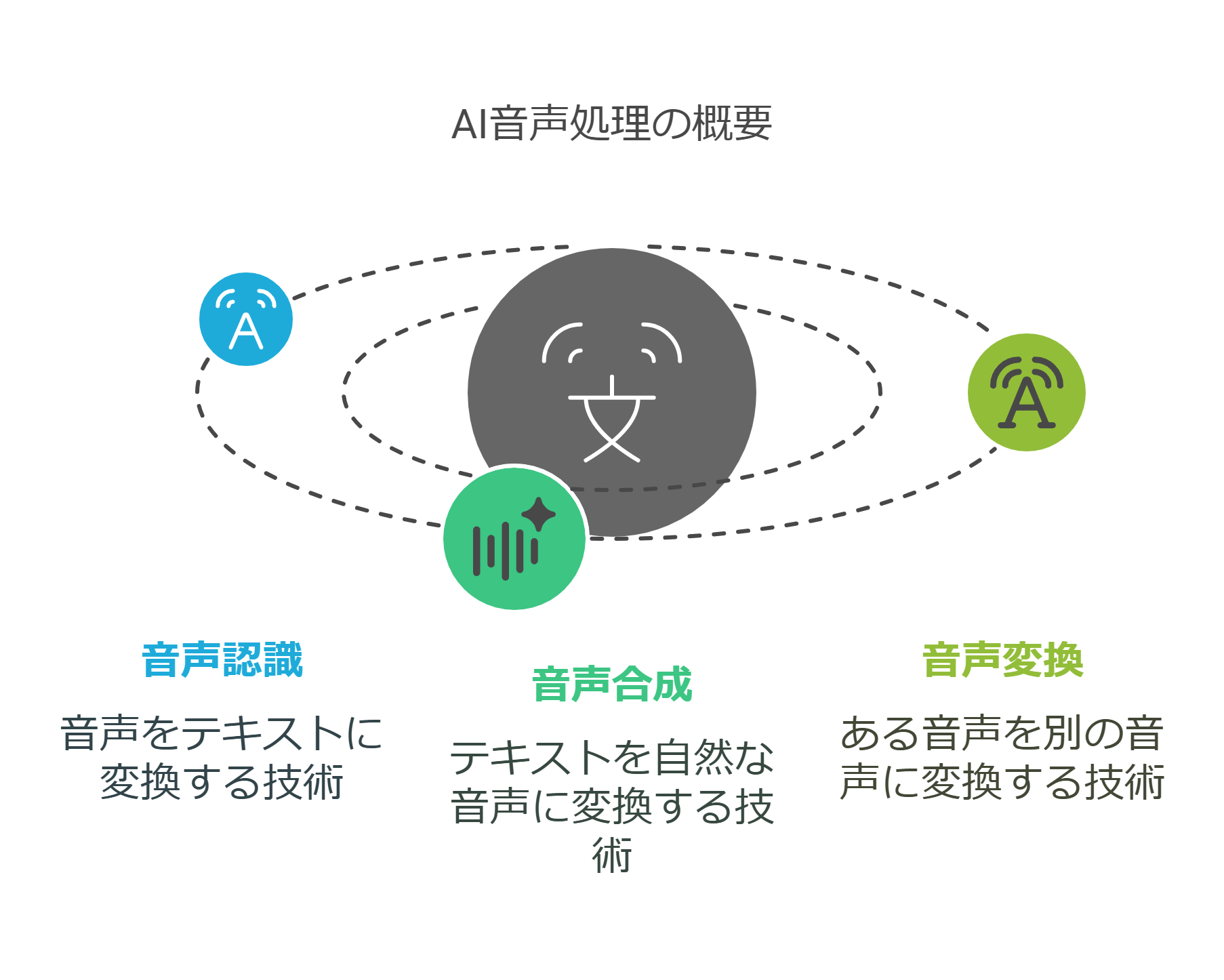

音声認識技術の仕組み

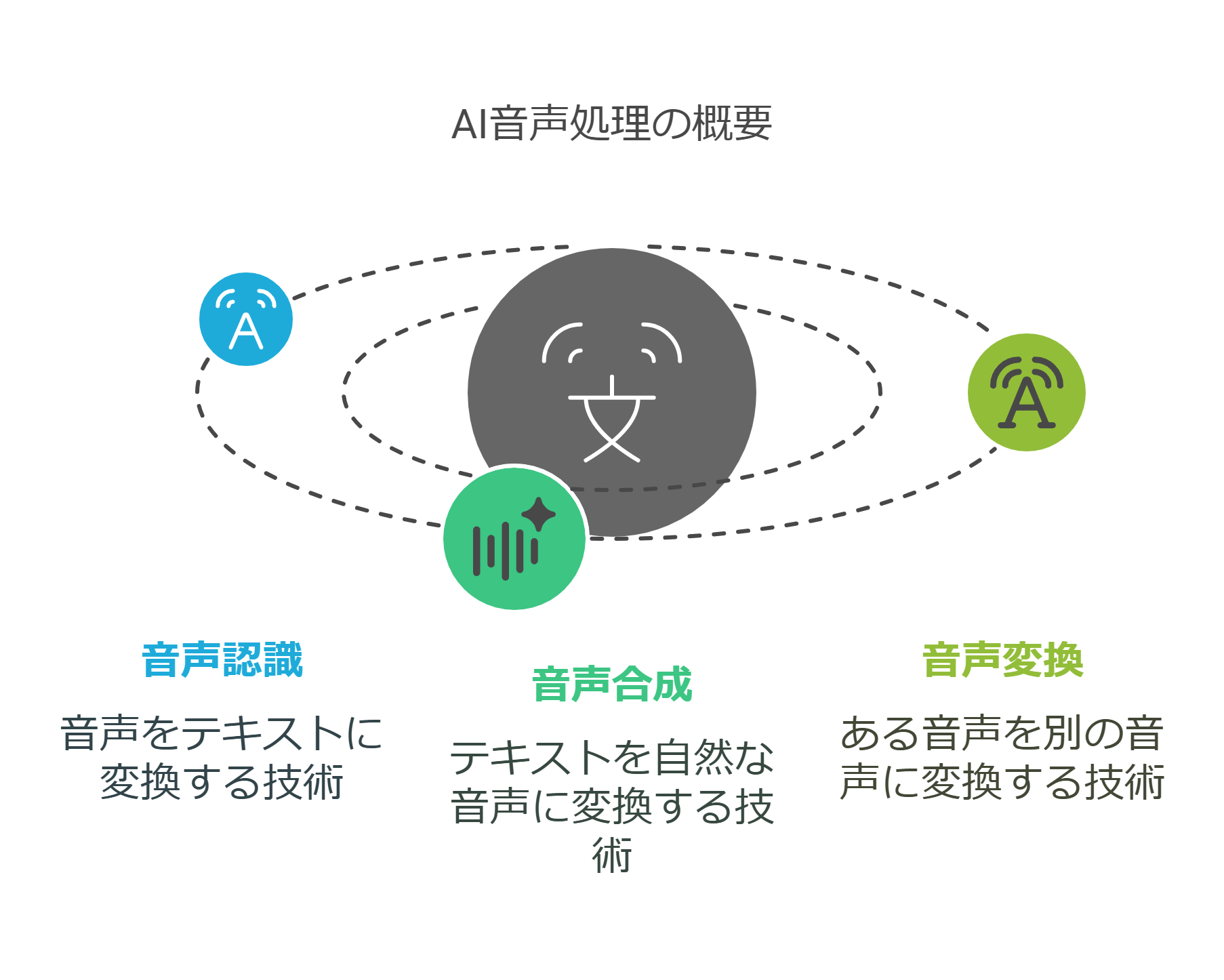

音声認識は、音声データをテキストに変換する技術です。

具体的には、ユーザーが発した音声をマイクやスマートフォンのマイクロフォンを通じて受け取り、その音声信号をデジタル信号に変換します。

この信号はAIアルゴリズムに渡され、そこでさらに分析が行われます。

音声認識の最初のステップは、音声信号を小さな音の単位(音素)に分解することです。

この過程で、言語に特有の音のパターンを識別するため、ニューラルネットワークが活用されます。

音素が識別されると、それらが組み合わさり、単語やフレーズを構成することができます。

さらに、音声認識システムは、言語モデルを用いて文脈を理解し、より正確な認識を目指します。

たとえば、周囲に雑音がある場合でも、AIは音声と雑音を区別する能力を持っています。

この技術には、深層学習(ディープラーニング)や自然言語処理(NLP)の技術が組み合わせられており、日々進化しています。

過去には雑音の多い環境で音声認識が難しかった時代もありましたが、現在では非常に高精度な音声認識が可能となり、実用化が進んでいます。

音声認識の精度は、使用するAIモデルの規模や学習データに大きく依存します。

たとえば、一般的な日本語や英語の発話は高精度で認識できますが、方言や特殊な発音が含まれる場合には、まだ改善の余地があります。

しかし、これらの技術は日々進化しており、今後は世界中の言語や方言にも対応できるようになると考えられています。

音声合成技術の仕組み

音声合成は、テキストを自然な音声に変換する技術で、音声認識と並んでAI音声処理の核心を成す技術です。

音声合成のプロセスは、テキストを一度デジタル信号に変換し、その信号をもとに音声を生成するものです。

音声合成の大きな進化は、音声の自然さを高めることにあります。

かつての音声合成は、ロボットのように機械的で硬い発声が多かったのですが、現在では人間らしい自然な声を生成する技術が確立されています。

これは、AIが音声のトーンやアクセント、発音速度などを柔軟に調整できるようになったためです。

音声合成技術は、以下の二つの主な方法で実現されています。

音響モデルと声データベース

従来の音声合成では、録音された声を組み合わせてテキストを音声に変換していました。

これは、事前に録音された大量の音声データを使って、特定の単語やフレーズを組み合わせることで、自然な発音を作り出す方法です。

しかし、この方法には限界があり、音声に違和感を覚えることがありました。

深層学習(ディープラーニング)を活用した音声合成

最近では、深層学習を用いた音声合成が一般的になり、AIが音声を生成するプロセスが進化しました。

これにより、より自然で人間らしい発音が可能になり、以前のような機械的な音声はほとんど感じられません。

特に、音声の抑揚やリズム、イントネーションに関してAIがより人間に近い発声を行うことができます。

AI音声合成技術の中で有名なものに「WaveNet」などのモデルがあり、これを使うことで、テキストを瞬時に自然な音声に変換することができます。

さらに、AIはさまざまな声の特徴を持つ声優データを学習することで、ユーザーの好みに合った声での合成も可能となります。

これにより、スマートスピーカーやカーナビ、音声アシスタントなどの音声がより親しみやすく感じられるようになります。

音声合成技術は、単に人間らしい声を再現するだけでなく、スピーチの速度や音量、感情の表現などにも対応できるようになっています。

これにより、ユーザーに対してより感情豊かな反応を示すことが可能となり、音声アシスタントの使いやすさが向上しています。

AI音声処理技術の精度向上

AI音声処理の精度向上は、深層学習(ディープラーニング)技術と大量のデータを活用することで成し遂げられています。

深層学習は、膨大なデータを学習させることで、AIが人間の脳のように多層的に情報を処理し、音声認識や音声合成を行うため、従来のアルゴリズムよりも圧倒的な精度を発揮します。

音声認識においても、深層学習を活用したニューラルネットワークは、音声の特徴を自動的に学習し、精度を向上させることができます。

このように、AIは音声認識だけでなく、意味理解やコンテキストの解釈も行うため、日々の会話において、よりスムーズで自然なやりとりを実現します。

音声合成においても、AIはテキストに含まれる感情を識別し、適切な感情を込めた音声を作り出すことが可能です。

これにより、より豊かな表現力を持った音声が生成され、ユーザーとの対話が一層親しみやすくなります。

AI音声処理の活用方法と事例

AI音声処理技術は、すでに多くの分野で実用化されています。

生活の中で見かけるさまざまなデバイスやサービスに組み込まれており、その利便性を高めています。

ここでは、代表的な活用方法についてご紹介します。

スマートフォンやスマートスピーカーでの活用

音声アシスタントは、AI音声処理の代表的な利用例です。

スマートフォンに搭載されている音声アシスタントは、音声認識技術を使ってユーザーの指示を理解し、適切な返答を行います。

たとえば、「明日の天気は?」といった質問に対して、天気情報を即座に提供する機能です。

また、スマートスピーカーは音声合成技術を駆使して、音楽の再生や家電の操作、さらにはスケジュールの確認など、さまざまなタスクを音声で実行します。

これにより、手を使わずに家の中で様々な作業をこなすことができ、日常生活の効率化が進んでいます。

カスタマーサポートでのAI音声処理

AI音声処理は、カスタマーサポート分野でも活用されています。

企業が顧客対応に使うコールセンターやチャットボットは、音声認識技術と音声合成技術を組み合わせることで、迅速で効率的なサポートを提供しています。

例えば、コールセンターで顧客が問い合わせをした際、AIはその内容を即座に理解し、最適な回答を音声で返すことができます。

このプロセスは人間のオペレーターよりも迅速で、長時間の待機を避けることができるため、顧客満足度の向上にも貢献しています。

自動翻訳技術の進化

AI音声処理は、自動翻訳の分野でも大きな進展を遂げています。

音声認識技術と翻訳技術が連携することにより、リアルタイムで言語を翻訳し、異なる言語を話す人々同士が円滑にコミュニケーションできるようになっています。

たとえば、外国語で会話をしている際に、AIが自動で翻訳を行い、その翻訳結果を音声として出力する技術が実用化されています。

この技術は、観光地でのコミュニケーションやビジネスでの国際的なやり取りに非常に役立ちます。

AI音声処理の未来と可能性

AI音声処理技術は、今後さらに進化することが予想され、その影響は私たちの生活のあらゆる側面に広がっていくでしょう。

これからの発展により、音声認識や音声合成の精度や自然さは飛躍的に向上し、私たちの生活の中でより一層活用されるようになります。

では、どのような進化が期待されているのでしょうか。

高精度な音声認識の実現

現在でも非常に高精度な音声認識技術が存在していますが、今後さらに精度が向上することが予想されます。

特に、方言や雑音を含む複雑な音声の認識能力が飛躍的に向上することでしょう。

今の音声認識技術でも、標準的な日本語や英語を使った発話には高い精度を誇ります。

しかし、さまざまな方言やアクセント、さらにはバックグラウンドノイズが多い状況では、認識精度が落ちることがあります。

例えば、繁華街の喧騒やカフェの雑音の中で音声を認識するのは難しいことがあります。

しかし、今後はこれらの課題を克服するための研究が進んでおり、AIが雑音を自動的に除去したり、特定の方言や訛りを認識したりする能力が向上するでしょう。

さらに、AIはリアルタイムで音声データを処理する能力を向上させることで、急速な会話や長時間にわたる講義、会議などでも的確に言葉を認識できるようになると期待されています。

これにより、世界中の異なる言語や方言が、誰でも簡単に認識できるようになるでしょう。

例えば、日本語の標準語と地方特有の方言が混じった会話でも、AIはその内容を正確に理解し、出力することができるようになると考えられています。

感情の理解と反応の向上

音声認識だけでなく、AIの感情理解能力も急速に発展しています。

将来的には、AIが単に言葉を理解するだけでなく、その背後にある感情や意図をも理解するようになるでしょう。

この進化は、音声アシスタントやカスタマーサポートの体験を大きく向上させるものとなります。

例えば、ユーザーが何かにイライラしていたり、ストレスを感じているとき、AIがその感情を音声のトーンや言葉の選び方から察知し、優しく対応することができるようになると予想されます。

逆に、ユーザーが喜んでいる場合やポジティブな感情を持っている場合には、AIもそれに適した応答をすることで、より良いコミュニケーションを築くことができます。

感情理解に関する技術は、音声トーンや言葉の選び方、発音の微妙な変化など、さまざまな要素を解析することによって、AIが感情のニュアンスを認識することを可能にします。

将来的には、AIは感情に基づいた適切な言葉遣いや声のトーンを使い分け、ユーザーに対して非常に人間らしい反応を返すことができるようになるでしょう。

音声インターフェースの革新

AI音声処理技術の進化により、音声インターフェースの重要性はますます高まっています。

特に、視覚や手の操作が難しい状況でも音声だけでシステムを操作できるようになることが期待されています。

これにより、さまざまな分野でアクセシビリティが向上し、より多くの人々が快適にテクノロジーを活用できるようになるでしょう。

例えば、視覚障害者がAI音声処理を利用して、音声でスマートフォンを操作したり、家電を管理したりすることが可能になります。

音声だけで情報を取得し、操作を行うことができるので、視覚に頼らずとも生活が成り立つようになります。

このような技術が普及すれば、視覚や運動に障害を持つ人々の生活の質が大きく向上し、より多くの人がテクノロジーを身近に感じることができるようになるでしょう。

さらに、車の運転中や手を使えない作業中でも、音声インターフェースを使ってデバイスやシステムを操作することができるようになります。

AIによる音声インターフェースは、危険を避けながら手軽に操作を行えるため、安全性も向上します。

これにより、忙しい日常生活の中でも効率的に作業をこなすことが可能になるでしょう。

より深い自然言語理解と対話型AIの進化

AI音声処理技術は、単なる音声認識にとどまらず、深い自然言語理解能力をも発展させています。

従来の音声アシスタントは、ユーザーが指示した内容をそのまま反映するだけのシステムでしたが、今後はより複雑な質問や会話を理解し、適切に返答する能力を持つAIが登場するでしょう。

たとえば、複数の命令を一度に受けてそれを処理したり、長い会話の中でユーザーの意図を的確に理解することができるAIが登場します。

これにより、ユーザーは自分が伝えたいことを自然に話すことができ、AIはそれに適切に対応することができるようになります。

将来的には、AIとの対話がますます人間との会話に近づき、ビジネスやエンターテイメント分野でも大きな変革をもたらすでしょう。

対話型AIは、教育や医療の分野でも新たな可能性を開き、専門的なアドバイスを提供することができるようになります。

まとめ

AI音声処理技術は、今後ますます進化し、私たちの生活に欠かせない存在になるでしょう。

現在でも多くの分野で活用されており、音声認識と音声合成を駆使したサービスは日々進化しています。

未来に向けては、精度の向上や感情の理解など、さらに高度な技術が実現されることが期待されます。

AI音声処理の技術がもたらす未来には、無限の可能性があります。

これからの技術革新に注目し、私たちの生活にどのような変化をもたらすのかを楽しみに待ちましょう。

コメント